Intelligenza artificiale, come cambierà la nostra vita? Lavoro, ambiente, etica: a che punto siamo in Italia

Marco Conti, direttore dell’Istituto di informatica e telematica del Cnr di Pisa e presidente del comitato tecnico scientifico della Fondazione Fair, coordina 350 ricercatori delle università e dei centri di ricerca di tutto il Paese: «Ecco quali sono i progetti in cantiere»

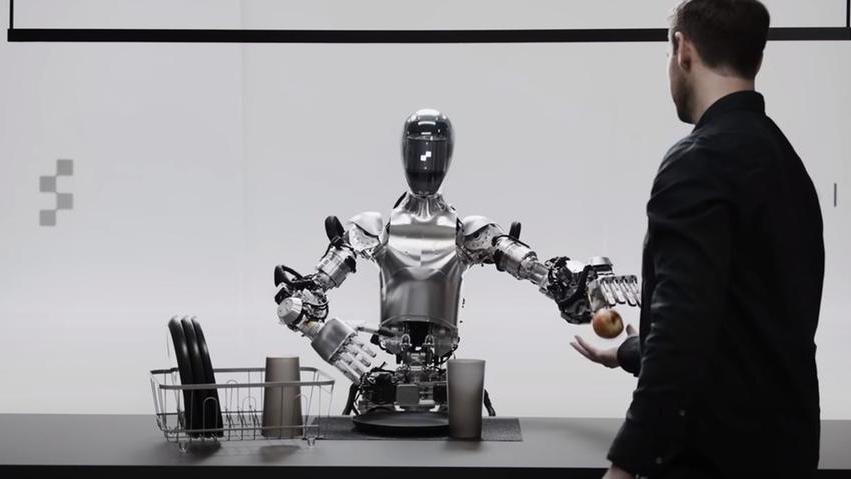

Figure 01 si muove come noi. E ragiona come noi. Almeno così sembra. «Cosa vedi sul tavolo? C’è qualcosa da mangiare? ». Con le sue dita metalliche e lo “sguardo” perso nel vuoto, il primo robot-umanoide che dà un corpo a ChatGPT di OpenAi, si presenta al mondo: afferra la mela e la passa all’unico umano nella stanza.

Nel video – pubblicato online una decina di giorni fa dalla startup Figure che l’ha realizzato – il dialogo continua. «Puoi spiegare perché mi hai dato la mela?». «Perché è la sola cosa commestibile presente sul tavolo», risponde. «Cosa pensi di fare con i piatti e i bicchieri?» Figure 01 afferra il piatto e il bicchiere e li mette nel cestello che è sul tavolo. È fantascienza? No, è già il presente, una scena domestica più vicina a noi di quanto pensiamo. Figure 01 dimostra di saper interpretare ciò che vede, grazie ai suoi sensori capisce il mondo che ha davanti, è in grado di sostenere un dialogo ragionato e di compiere azioni muovendosi come un essere umano.

Un mondo affascinante quello dell’intelligenza artificiale generativa ma anche destabilizzante perché potenzialmente in grado di sovvertire dinamiche che ritenevamo ineluttabili. Dialogare con “esseri” fatti di metallo, chip e reti è davvero possibile. Ma c’è di più. Sono pensati per avere anche più competenze e capacità rispetto a noi riuscendo a fare in pochi secondi ciò che l’uomo non potrebbe mai fare in una vita intera.

(Marco Conti, direttore dello Iit-Cnr e presidente del comitato tecnico scientifico della Fondazione Fair)

La sfida del Cnr di Pisa

Al Cnr di Pisa ha sede la Fondazione Fair (“Future AI Research”), un partenariato esteso sull’intelligenza artificiale che coinvolge a oggi 350 ricercatori delle università e dei centri di ricerca di tutta Italia e sette grandi aziende finanziato con 115 milioni di euro del Pnrr. A questo primo nucleo di scienziati si stanno aggiungendo altri 150 giovani ricercatori e 100 dottorandi distribuiti su tutto il territorio nazionale, assunti per lavorare a tempo pieno sul progetto.

Alla guida di questa macchina di cervelli che ci porterà nel futuro c’è il professor Marco Conti, direttore dell’Istituto di informatica e telematica del Cnr di Pisa e appunto presidente del comitato tecnico scientifico di Fair: «L’obiettivo è quello di sviluppare un’intelligenza artificiale incentrata sull’uomo, affidabile e sostenibile, di far crescere nuovi talenti in questo settore di ricerca e contribuire a trattenerli in Italia, e di promuovere l’innovazione e lo sviluppo di tecnologie basate sull’intelligenza artificiale, creando attorno a Fair un ecosistema nazionale di università, aziende ed enti di ricerca», spiega.

ChatGPT in italiano

Tanti i progetti in cantiere: dalla ricerca sui “modelli linguistici di grandi dimensioni” – che porterà fra le altre cose alla creazione di un modello linguistico allenato direttamente su testi italiani (una sorta di ChatGPT in italiano) – allo sviluppo di sistemi intelligenti che collaborano con le persone. Seguendo un principio fondamentale: la macchina come supporto all’uomo nel prendere le decisioni e non per prendere decisioni al posto dell’uomo.

Dati e potenza di calcolo

«I modelli linguistici di grandi dimensioni come ad esempio ChatGPT – spiega Conti – di solito sono addestrati su testi in lingua inglese, con un taglio culturale anglosassone che viene assorbito dal modello e ne va a influenzare le risposte. Noi stiamo lavorando per lo sviluppo di un “modello linguistico di grandi dimensioni” addestrato sull’italiano e quindi vicino alla nostra cultura e ai nostri valori. Grazie a un’alleanza con il consorzio Cineca di Bologna possiamo utilizzare il calcolatore Leonardo, uno dei più potenti a livello mondiale ma per allenare i modelli abbiamo bisogno anche di una grande quantità di dati di qualità e stiamo operando per avere l’accesso a banche dati nazionali affidabili. In generale il lavoro di Fair – continua – si divide in tre grandi blocchi: uno sull’intelligenza artificiale antropocentrica che indaga anche gli aspetti etici e legali, uno sulla robustezza e affidabilità degli algoritmi e il terzo sull’efficienza e la sostenibilità, visto che l’intelligenza artificiale a oggi per funzionare ha bisogno di una grande quantità di risorse, in primis l’energia elettrica».

Big tech VS Europa

Un maxi investimento che mira a rendere l’Italia competitiva nel settore a oggi dominato a livello mondiale da una decina di colossi della tecnologia – fra questi Google, Amazon e Facebook – le cosiddette “big tech” che hanno a disposizione grandi potenze di calcolo, grandissime quantità di dati per l’addestramento dei modelli e tanti, tanti soldi. «Intelligenza artificiale significa creare dei sistemi che abbiano un comportamento simile all’intelligenza umana – chiarisce Conti – dato un certo problema l’obiettivo è che la macchina abbia una reazione quanto più simile a quella di un umano. A livello europeo siamo un po’ indietro con lo sviluppo dell’intelligenza artificiale ma le grandi compagnie hanno un approccio soprattutto “muscolare”: creo modelli sempre più grandi, che alleno su enormi quantità di dati utilizzando calcolatori sempre più potenti ed energivori. Il risultato sono modelli che danno delle risposte che in apparenza sono intelligenti ma che in realtà intelligenti non sono. A livello europeo si sta tracciando una strada diversa – continua – che non sia solo muscolare ma che porti alla creazione di sistemi in grado di supportare la persona in modo affidabile, sicuro e sostenibile mantenendo l’attenzione sui valori e principi etici. Grazie al partenariato che abbiamo costituito, l’Italia punta a creare una massa critica che ci permetta di essere tra i primi attori almeno a livello europeo».

L’IA tra presente e futuro

Certo è che negli ultimi vent’anni lo sviluppo dell’intelligenza artificiale è cresciuto in maniera esponenziale e tanti sistemi fanno già parte della nostra vita: dai cosiddetti assistenti virtuali come Siri e poi Alexa, ai vari sistemi di raccomandazione dei nostri smartphone che ci suggeriscono – dopo averlo appreso dall’analisi dei nostri comportamenti – ciò che più ci interessa o ci è utile, dalle info sul traffico ai percorsi più brevi fino ai libri che ci piacerebbe leggere.

Ma passi da gigante sono stati fatti in tantissimi settori, dall’industria agroalimentare, dal turismo alla sanità. «In questo momento lo sviluppo dell’intelligenza artificiale è cresciuto molto nella traduzione del linguaggi – dice Conti – ma anche nella “computer vision” con veicoli autonomi in grado di identificare e reagire alla segnaletica stradale e poi con sistemi di riconoscimento facciale utilizzati ad esempio in Cina durante il Covid per sorvegliare il comportamento dei cittadini: un sistema questo, che in Europa, in base all’AI Act appena approvato è in generale vietato e può essere utilizzato solo per la prevenzione di reati gravi. Ma è sul campo medico che si concentrano forse la maggior parte delle aspettative – continua il presidente di Fair – purché si utilizzi l’intelligenza artificiale in modo consapevole, in quanto non abbiamo garanzie sulla completa affidabilità delle sue risposte. La stessa ChatGPT a volte ha delle cosiddette “allucinazioni”. Queste macchine sono scatole nere il cui funzionamento finale non può essere predetto nemmeno da chi l’ha progettato. La medicina è un settore delicato nel quale non si possono correre rischi. Nelle radiografie e nelle Tac, l’intelligenza artificiale si sta dimostrando efficace per identificare ad esempio la possibilità che un certo segnale sia un tumore. Una macchina “intelligente” può fare uno screening di una Tac e dare al medico un’indicazione delle possibili problematiche e lo può fare bene senza stancarsi, 24 ore al giorno e con bassissimo margine di errore ma poi è il medico che deve prendere la decisione ed essere in grado di capire se la macchina ha detto una cosa corretta o meno».

L’impatto sul lavoro

Una rivoluzione ancora silenziosa ma già profondamente in atto, che avrà un impatto enorme sul lavoro e sui livelli occupazionali con scenari più o meno allarmistici che vedono professionisti di diversi settori destinati a scomparire.

E se secondo Conti nel futuro non dobbiamo immaginarci giudici o insegnanti virtuali, è invece altamente probabile che le “figure di supporto” a determinate professioni vengano rimpiazzate dalle macchine. «Per rimanere nel settore della giustizia – dice – potranno sparire dagli studi degli avvocati i giovani apprendisti incaricati di fare le ricerche sulle sentenze pregresse perché le ricerche le farà in modo più preciso l’intelligenza artificiale. Ma in generale nessun settore è esente dal rischio. In passato le macchine hanno portato a una riduzione degli operai, ora andranno a toccare anche i cosiddetti “colletti bianchi”. Il lavoro routinario, seppur svolto da laureati, verrà pesantemente colpito. La qualità del lavoro umano si alzerà, su 100 professionalità ne rimarranno 10 che saranno quelle a più alto contenuto cognitivo e professionale che dovranno valutare ciò che la macchina suggerisce e prendere la decisione finale».

Il nodo della sostenibilità

Ma quanto costa mettere in piedi un sistema basato in maniera così prepotente sulle macchine? Di quanta energia elettrica abbiamo bisogno per far funzionare server e centri di calcolo? Secondo Conti è questo uno dei più grandi limiti col quale dovrà scontrarsi l’approccio delle big tech basato sulla “forza bruta”. «Questo tipo di approccio richiede molte risorse energetiche e finanziarie ed è chiaro che non potremmo andare avanti continuando ad aumentare senza limiti le risorse impiegate anche perché – dice – l’incremento del beneficio che si ottiene non è in generale comparabile all’incremento delle risorse utilizzate e dobbiamo quindi pensare ad approcci più sostenibili. Ora si punta molto sull’aumento della potenza dei calcolatori e della quantità di dati ma questa non può essere la strada per il futuro perché non sarebbe sostenibile».

Il ruolo dell’etica

E poi c’è l’etica dell’intelligenza artificiale dalla quale non si può prescindere per tracciare la visione del futuro che vogliamo costruire. Perché è vero che questa tecnologia sembra destinata a migliorare la qualità delle nostre vite ma ci sono anche dei rischi. «Con lo scandalo di Cambridge Analytica abbiamo toccato con mano quanto questi strumenti possano essere pericolosi per la democrazia – dice Conti – è giusto e corretto che l’intelligenza artificiale debba essere etica e trasparente. Il problema è trovare il giusto bilanciamento tra lo sviluppo della tecnologia e la protezione dei valori e principi etici. Cina e Stati Uniti tendono a privilegiare lo sviluppo tecnologico. Gli Usa hanno la consapevolezza che l’intelligenza artificiale non si possa lasciare senza controllo ma si tende a lasciare alle aziende la capacità di autoregolarsi. In Europa con l’AI Act è stata definita una regolamentazione dell’intelligenza artificiale che cerca di trovare questo bilanciamento. Il regolamento però deve ora essere recepito dagli Stati membri nelle legislazioni nazionali e questo non avverrà in modo uniforme e potrà avere quindi significative ripercussioni sull’economia e la società. Si tratta di un passaggio fondamentale anche perché in passato in Italia siamo stati più conservativi di altri».